Cadenas de Markov en la Toma de Decisiones: Modelos Probabilísticos para la Gestión Adaptativa de Procesos en BPM.

En entornos donde la incertidumbre es inherente —desde sistemas de atención al cliente hasta estrategias de negocio— las cadenas de Markov ofrecen una herramienta matemática poderosa para modelar, simular y optimizar decisiones. Su aplicación en la gestión por procesos permite transformar reglas estáticas en sistemas adaptativos, capaces de responder dinámicamente al contexto operativo.

1. Fundamentos: ¿Qué es una cadena de Markov?

Una cadena de Markov es un proceso estocástico que transita entre estados discretos con ciertas probabilidades. Su propiedad clave es la memoria limitada: la probabilidad de transición depende únicamente del estado actual, no del historial completo.

Formalmente, si Xn representa el estado en el paso n, entonces:

P(Xn+1 = x ∣ Xn = xn, Xn−1 = xn−1, …, X0 = x0) = P(Xn+1 = x ∣ Xn = xn)

Este marco permite representar sistemas complejos con comportamiento incierto, pero gobernado por patrones probabilísticos observables.

2. Aplicación en eventos indeterminados

Los eventos indeterminados —como el comportamiento de usuarios, fluctuaciones de mercado o evolución de sistemas— pueden modelarse como cadenas de Markov cuando:

- Existen estados discretos identificables.

- Se pueden estimar probabilidades de transición entre ellos.

- El sistema evoluciona en pasos secuenciales (tiempo, iteraciones, fases).

Ejemplos prácticos:

- Sistemas de apuestas: modelar la evolución de una serie de jugadas, detectar ciclos de pérdida/ganancia y ajustar estrategias.

- Análisis de comportamiento de clientes: predecir abandono, conversión o fidelización.

- Procesos logísticos: estimar probabilidades de entrega, retraso o devolución.

3. Toma de decisiones basada en estados

Integrar cadenas de Markov en la toma de decisiones implica:

- Definir estados relevantes del sistema (por ejemplo, “cliente activo”, “en riesgo”, “inactivo”).

- Estimar transiciones entre estados a partir de datos históricos o simulaciones.

- Diseñar reglas adaptativas que respondan al estado actual con acciones óptimas.

Esto permite construir sistemas que no reaccionan de forma rígida, sino que se adaptan al contexto probabilístico del momento, anticipando riesgos y oportunidades.

4. Gestión por procesos: de lo determinista a lo probabilístico

La gestión por procesos (Business Process Management, BPM) busca optimizar el flujo de trabajo dentro de una organización. Tradicionalmente, se basa en:

- Diagramas de flujo deterministas.

- Reglas de negocio estáticas.

- Métricas de rendimiento agregadas.

Sin embargo, los procesos reales presentan:

- Variabilidad en tiempos de ejecución.

- Comportamiento humano impredecible.

- Excepciones, bucles y desviaciones.

Las cadenas de Markov permiten modelar esta dinámica real, incorporando incertidumbre y adaptabilidad.

5. Aplicaciones concretas en BPM

– Modelado probabilístico de procesos

En lugar de asumir que cada tarea sigue a otra de forma fija, se modelan transiciones con probabilidades. Esto permite:

- Detectar cuellos de botella.

- Identificar estados críticos donde el proceso se estanca.

- Simular trayectorias posibles para anticipar resultados.

– Simulación y análisis de escenarios

Con matrices de transición y estados definidos, se pueden simular miles de ejecuciones del proceso, estimando:

- Tiempo medio hasta resolución.

- Coste esperado por ciclo.

- Probabilidad de éxito o fallo.

Esto facilita la toma de decisiones basada en riesgo, en lugar de reglas rígidas.

– Optimización dinámica de reglas

Las reglas de negocio pueden adaptarse según el estado actual del proceso. Ejemplo:

- Si un cliente ha pasado por tres estados sin resolución, se activa una intervención especial.

- Si la probabilidad de abandono supera cierto umbral, se prioriza su atención.

Esto convierte los procesos en sistemas adaptativos, más resilientes y centrados en resultados.

6. Estado actual de la técnica

Investigación y academia

Las cadenas de Markov están bien establecidas en teoría de colas, simulación estocástica y minería de procesos. Avances relevantes:

- Process mining probabilístico: extraer modelos de procesos a partir de logs reales con transiciones probabilísticas.

- Markov Decision Processes (MDP): integrar decisiones y recompensas en cada estado para optimizar políticas.

Aplicaciones prácticas

Aunque su uso aún no está masificado en herramientas BPM comerciales, hay avances en:

- Simuladores de procesos como ProM, Celonis o Disco.

- Integración con IA: modelos de Markov combinados con aprendizaje automático para predecir comportamientos.

- Automatización inteligente: plataformas low-code que incorporan lógica adaptativa basada en estados.

Limitaciones actuales

- Requieren datos históricos bien estructurados.

- La interpretación de estados puede ser ambigua si no se definen con precisión.

- La escalabilidad en procesos complejos con muchos estados aún es un reto.

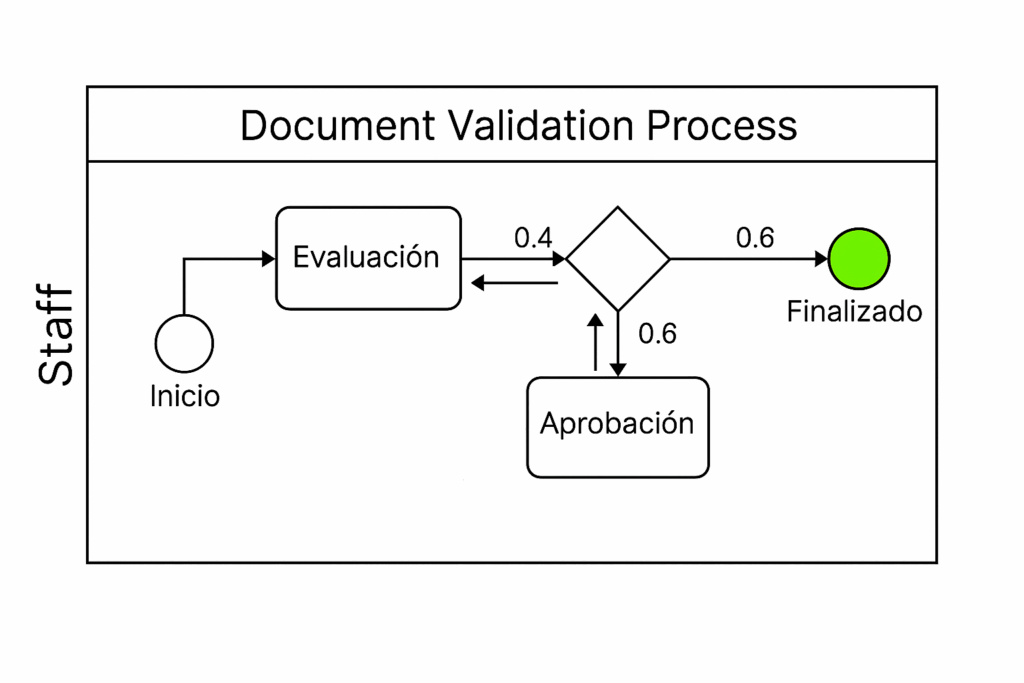

7. Visualización en BPMN

Aunque BPMN no contempla transiciones probabilísticas de forma nativa, es posible representar una cadena de Markov mediante:

- Tareas como estados del sistema.

- Gateways exclusivos como nodos de decisión probabilística.

- Flujos de secuencia con anotaciones de probabilidad.

- Eventos de inicio y fin como estados iniciales y absorbentes.

Esto permite integrar el modelo probabilístico en diagramas de procesos empresariales, facilitando su comprensión y aplicación.

8. Conclusión: hacia procesos conscientes del contexto

Las cadenas de Markov permiten pasar de una gestión por procesos rígida a una gestión probabilística adaptativa, donde las decisiones se toman en función del estado actual y su evolución esperada. En un entorno empresarial cada vez más dinámico, esta capacidad de anticipación y ajuste puede marcar la diferencia entre la eficiencia y la obsolescencia.

Referencias

- Cadena de Márkov – Wikipedia

Página oficial en español que explica los fundamentos teóricos de las cadenas de Markov, incluyendo definiciones formales, tipos de cadenas (homogéneas, no homogéneas), y ejemplos clásicos.

Video recomendado

La Extraña Matemática Que Predice (Casi) Todo – Veritasium

Este video explica de forma clara y visual cómo las cadenas de Markov pueden aplicarse para predecir comportamientos en sistemas complejos. Ideal para introducir el concepto a lectores no técnicos.